2025年04月19日

■ 【足掛け12年の総括】統計目的の二次利用が決定利用禁止を条件に許される理由が1997年勧告に明記されていた

2月1日にこれを見つけたので、大急ぎで邦訳を作成し解説を加えてJILISレポートに仕上げ、先週公開した。

- 欧州評議会「統計目的で収集・処理される個人データの保護に関する加盟国への閣僚委員会勧告」(1997年)の紹介, JILISレポート7巻3号 (2025)

なぜ、1997年のこれを今急いで紹介する必要があるのかと言えば、今の個人情報保護法3年ごと見直しで個情委から示された「個人情報保護法の制度的課題に対する考え方について」(令和7年3月5日)の一丁目一番地である「第1-1-(1) 統計作成等、特定の個人との対応関係が排斥された一般的・汎用的な分析結果の獲得と利用のみを目的とした取扱いを実施する場合の本人の同意の在り方」に直結するからだ。

これまで、統計目的の本人同意なき二次利用が問題とならないことを説明するには、GDPR 5条1項(b)と9条2項(j)の規定が事実そうなっていることを挙げ、また、それが許される理由が非選別利用に限るところにある(措置または決定に用いないところにある)旨を説明するには、GDPR前文162で「The statistical purpose implies that …… and that this result or the personal data are not used in support of measures or decisions(措置または決定)regarding any particular natural person.」と仄めかされている*1(データ保護指令では要件として明確に書かれていたのだが*2)ところを挙げるしかなかった。

それが、今回見つけた欧州評議会の1997年勧告では、説明覚書において、そこの理由が明確に述べられていたのである。これを早く見つけていれば話はもっと簡単だったのに、誰もこれに言及していなかったのである*3。

これまでにやってきたこと

振り返れば、私が、統計目的の本人同意なき二次利用が問題とならないことを明確に言い出したのは、平成27年改正法案の骨子が出た時期(2014年末)であった。この時は、統計利用が目的外利用になると思い込んでいる経済界の要望に応えようとした経産省が、利用目的の変更をオプトアウトで可能にするという破壊的な改正をゴリ押ししていたところを、元々適法である旨を指摘して瀬戸際で食い止めたのであった*4。この時点ではまだ、EU法でも統計利用が許されていることをわかっておらず、当時の経産省Q45をを拠り所にしていた。

この主張は、2013年のSuica事案(統計目的の提供)を問題視した態度と矛盾しているように見えたかもしれないが、そうではない。Suica事案の問題は、仮名化すれば非個人情報になるという誤った法解釈で進められていたところにあり、そのような解釈が既成事実化してしまえば、仮名化データの転々流通を法的統制なしに許すことになるので、避けなければならなかった。委託方式でなら許されることを当初から示していた*5ように、統計に利用されるという結果が問題なのではなく、提供に係る規制の設計の問題(現行法をどう解釈し直していくか)だった*6。

その後、2015年までに、古い国内文献を読んだことで、そもそも公的部門では(というより昭和63年法から)目的内提供が認められており、統計目的の提供も許されていることに気づき、OECDガイドラインも問題視しているのは目的外だということを知り、日本法は民間部門の第三者提供の規制が部分的に過剰なのだと理解するに至った*7。

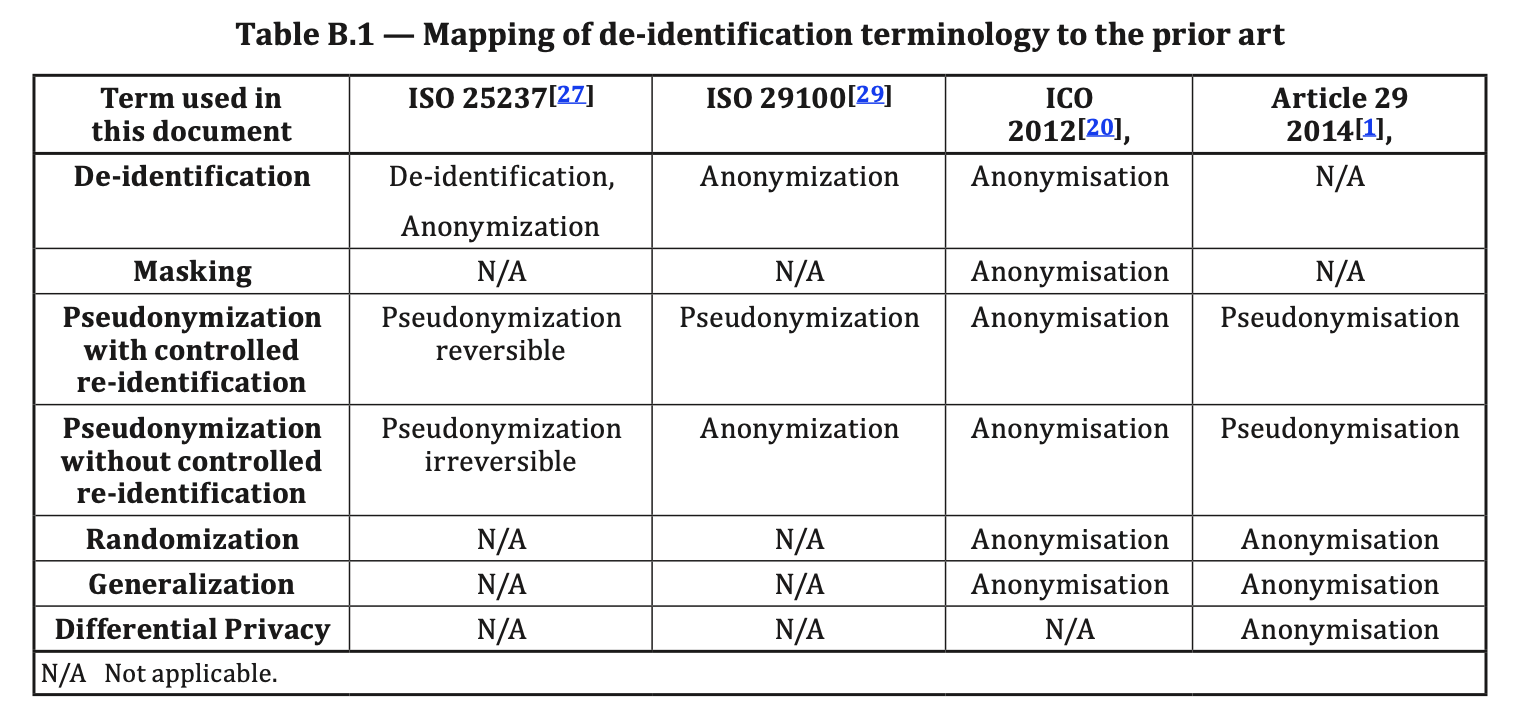

2015年から2017年前半にかけては、医学系指針との整合性確保に力を注いでいた。当時は、平成27年改正を経て、「匿名加工情報」の匿名加工が、今で言う仮名化のことではなくEU法における匿名化(GDPRの「anonymous information」相当)のことであるという理解が確立しつつある時期で*8、医学系指針が仮名化の意味で「匿名化」の語を使ってきた歴史的経緯と矛盾をきたしていたので、そこをどう直していくかの活動だった*9。後になって明確にわかったが、このような展開は、日本だけのことではなく、国際的にも同様であり、ISO/IEC 20889:2018のAnnex B「Prior art terminology」を見れば*10、国際的に用語が混乱(あるいは変遷)していた様子がわかる。

2017年後半ごろには、この辺りの混乱が収束しつつあり*11、次なる目標として、医療データの本人同意なき二次利用を許す(実態としては既に行われている*12ものの、適法な慣行として位置付けるための)制度改善の主張を展開するようになり、以下のように進めてきた。このころから、EU法でも統計利用が許されている旨を主張するようになった。

- 2017年12月4日 「研究目的医用画像データベース構築の適法化整理のために」JEDI倫理課題研究WG 第2回大規模医用画像データベース構築に向けた倫理的問題検討会議*13 *14 *15

- 2020年2月21日 「医療仮名データ立法の提案 海外動向を踏まえて」自由民主党本部 政務調査会データヘルス推進特命委員会 国民視点のデータヘルス法制WG*16 *17

- 2020年12月5日 「個人情報保護法制 令和3年改正のその先に向けて」情報法制学会 第4回研究大会JILIS報告*18 *19

- 2022年7月22日 「仮名加工医療データの統制された非選別利用に向けた立法論」第6回情報法制シンポジウムDay1*20 *21

- 2022年8月10日 「デジタル社会を駆動する「個人データ保護法制」に向けて」GLOCOM六本木会議オンライン#48*22

- 2022年11月7日 「個人データ保護の法目的の観点から導かれる個人データ二次利用の正当性要件について」規制改革推進会議 医療・介護・感染症対策WG*23

- 2022年12月22日 「【提言書公表】デジタル社会を駆動する『個人データ保護法制』に向けて」GLOCOM六本木会議*24

- 2023年7月1日 「緊急アピール:どうなる?規制改革の医療データ二次利用〜「デジタル社会を駆動する『個人データ』保護法制に向けて」提言フォローアップ」六本木会議オンライン#62*25

- 2025年1月21日 「データ利活用に対する個人情報保護法の支障と解消」デジタル行財政改革会議 第2回データ利活用制度・システム検討会*26

これらの脚注に詳細を書いているように、統計目的の本人同意なき二次利用がなぜ許されるのかの私の説明方法は、傍証を積み重ねることによって徐々に強化されてきた。

ところが!今回見つけた欧州評議会の1997年勧告「統計目的で収集・処理される個人データの保護に関する加盟国への閣僚委員会勧告」(の説明覚書)には、脚注で挙げているような論点の全てが既に書かれていたのだ。欧州ではとっくに整理が済んでいる話だったのだ。

欧州評議会1997年勧告が示していること

勧告の説明覚書に書かれている重要な点は、今回のJILISレポートの解説パートに解説を書いたので、それを読んでいただきたいが、ここでは、解説の解説、あるいは別の角度からの解説を加えたい。

まず、この勧告の位置付けは、欧州評議会条約108号「個人データの自動処理に係る個人の保護のための条約」に基づくものであり、EU法(データ保護指令からGDPR)もこの条約に適合することが基礎となっているのであるから、GDPRの統計目的に係る規定も、この勧告に沿っているものと見るべきだろう。

1980年採択*27のこの条約では、統計目的のデータについては、9条3項*28で、開示請求等の権利を国内法で制限できることを規定*29していただけであったが、統計目的の二次利用が目的外利用に当たらないことが1995年のデータ保護指令で明記され、それに歩調を合わせながら1997年のこの勧告で、条約108号においても同様であるとの解釈が示されたものと言える。実際、2018年の「条約108+」では、EU法に合わせてこの点が見直され、統計目的での更なる処理(further processing)が適切な保護措置を前提に元の目的とcompatibleであることが明記(5条4項b)されており、条約とEU法は連動して発展している。

JILISレポートの解説パートでは、「注目すべき点」として、①「個別的決定」の概念、②「決定または措置」利用の禁止、③「二次収集」の規律、④データ対象者の権利制限、⑤「匿名」概念と「個別データ」、⑥「突合」処理への識別データの使用、⑦比例性とデータ品質の原則を挙げて、解説している。

これらの見出しからでも推察されるように、統計目的の二次利用について「決定または措置」利用の禁止を前提に許されることが書かれている。例えば、説明覚書の第14段落、第57段落で、次のように書かれている。

14. 科学研究は、知識の進展を促進する様々な手段の一つとして統計を利用する。実際、科学的知識は、それが適用されるすべての個人を超越する恒常的な原則、行動法則、または因果関係のパターンを確立することにある。したがって、それは集合的現象を特徴づけることを目指すものであり、これこそが統計結果の定義そのものである。このため、研究はその発展の特定の段階において統計的なものとなると言うことができる。

a. ⽣物学および⼈間科学において、研究過程の多くは実験を伴う。この領域では、個別化された介⼊(personalised intervention)が研究の基礎となっており、統計的分析が後の段階で⽤いられる可能性があるとしても、ここで定義される統計の分野には含まれない特定の倫理的・法的規則を必要とする。

b. これに対して、本勧告が対象とする統計は、基礎情報を提供するデータ対象者への干渉(interference)を最小限にするという原則に基づいて機能する。一方で、問題となる情報は統計調査に先立って存在していたものであり、データ対象者の状態、行動、または意見に対する実験的な変更を伴わない。他方で、後者による情報収集の実際の過程を通じて、可能な限り混乱を最小限に抑えるよう、あらゆる努力が払われる。このような統計的枠組みの中で収集されたデータは、研究目的のために使用することができるが、ただし、関係する個人への個別化されたフィードバック(personalised feedback)が一切ないという厳格な条件の下においてのみである。

57.(略)c. 統計目的には、当該研究が個人データの処理操作と分析からなり、特定の母集団における集合的現象を特徴づけることを目的とする場合には、科学研究が含まれる場合がある。しかし、統計目的は、個人に関係する科学研究または個人に関する決定や措置(decisions or measures)につながる可能性のある研究とは完全に両立しない(totally incompatible)(第14段落および第102段落cを参照)。

これらの記述が言わんとしていることは、科学研究は統計を利用するが、一般に、科学研究といえば、被験者への介入(intervention)を伴うものも多いけれども、ここではそういうものを対象とせず、データ対象者への個別化されたフィードバック(personalised feedback)が⼀切ないような科学研究のみが対象となるということである。それに対して、被験者への介入を伴う科学研究には、別途「倫理的・法的規則」を必要とすると書かれており、裏を返せば、介入のない(正確には、個別化されたフィードバックのない、あるいは、決定または措置(decisions or measures)につながらない)研究にはそれは不要であるということを意味している*30。

2023年の規制改革では「不利益決定は問題だが利益決定は禁止する理由がない」とされてしまった(注25)のに対して、このように、欧州評議会勧告では、個別化されたフィードバックが⼀切ないことを条件としており、不利益決定だけでなく利益決定への利用も許さないとされている。説明覚書第10段落にも、「不利益(detriment)または利益(benefit)をもたらす厳密に個別的な決定を下すこと——例えば行政的、医療的、法的、その他の決定」との文があり、不利益決定と利益決定を区別しないことを意識している様子がわかる。やはり言っていた通りなのだ。

2020年の研究大会では「統計利用が正当化されるのは公益性があるからではなくそもそも権利利益を害さないから」ということを主張していた(注19)わけだが、同旨のことが、説明覚書第29段落にズバリ書かれていた。

29. 目的の濫用のリスク:この関連において、統計処理そのものがデータ対象者にとって脅威となるのではなく、それが基づくデータが非統計的目的に流用される可能性があるという事実が脅威となることを指摘しておくべきである。したがって、問題は、他の公益目的での利用の場合にみられるような、統計の利益とデータ対象者の利益との間でバランスを取るといった類のことではない。実際、統計はそれが重要なものかどうかにかかわらずいかなる場合もデータ対象者の利益を侵害しない以上、統計の利益がデータ対象者の利益の侵害を正当化する余地はない。問題となっているのは、識別可能なデータを保有することから生じるリスクである。そのため、職業倫理と本勧告に含まれる原則の双方の観点から、そのリスクの防止が強調されている。

日本でも昔から「保護と利活用のバランス」と言われるが、このように、統計目的の二次利用については、(適切なsafeguardsがあれば)権利利益が害されない(権利利益の保護が損なわれない)ので、保護とのバランスの話ではないわけである。やはり言っていた通りなのだ。

我々の言っていた「統制された非選別利用」(注18)の法的保障は、その「safeguards」に相当するものであり、「それが基づくデータが非統計的目的に流用される可能性」を排除することにある。これが、決定利用禁止であり、その実効性を確保するための転々流通防止である。

「決定」に相当する概念は、欧州評議会勧告では「決定または措置(decisions or measures)」との表記が用いられている。EU法では「measures or decisions」となっていて語順が逆だが、その意図は不明であった。そもそも「decisions」とは別の「measures」の意味は何かが疑問となるが、その明確な答えは書かれていなかった。ドイツ法では「Maßnahmen oder Entscheidungen」(措置または決定)が定型フレーズになっているようなので、そこに起源があるのかもしれないが、確認できていない。いずれにしてもこの区別にはあまり意味がないと思われる。個人毎に異なって与える何かしらの影響(個別化されたフィードバック)の全てが含まれるということだろう。

Jon Bingの「決定指向利益モデル」を理解して以降、決定利用を禁止すれば統計目的の二次利用が許される理由を、そもそもデータ保護法の目的が「決定」の適切性確保にあるからだと説明できるようになった(注20)が、同旨のことが、説明覚書第88、89段落に書かれている。

88. 原則7.1は、条約における保証を喚起している:すべての者は、自己に関する個人データへのアクセスを得ることができ、また、それらのデータが誤りである場合や不正確である場合には、管制者にそれらを訂正させることもできなければならない。この規定の目的は、特に、ファイルに保持され管制者により第三者に開示される可能性のある誤りのあるまたは不正確なデータに基づいて、個人に関する措置または決定(measures or decisions)が講じられないことを確保できるようにすることである。

89. データが専ら統計目的で収集・処理される場合、そのようなリスクは存在しない(第65段落を参照)。さらに、原則3.1の下では、管制者は統計目的で収集されたデータを正当に修正することができ、アクセス権の目的(データの正確性を保つこと)は、この文脈では意味をなさない(第65段落cを参照)。(略)したがって、起草者らは、条約の目的に照らし、ここではアクセス権と訂正権の制限を認めることが望ましいと考えた。(略)

この段落は、開示請求等の権利を制限できるとする理由を述べている箇所であるが、このように、法の目的が「誤りのあるまたは不正確なデータに基づいて、個人に関する措置または決定(measures or decisions)が講じられないことを確保」することにあるから(統計目的では措置または決定をしないので問題とならない)と説明されている。やはり言っていた通りなのだ。

2020年の研究大会で「統制された非選別利用」を提案した際には、「複数組織からの個人データを突合する必要性」に触れ(注18)、2022年のシンポジウムで「IDを残した仮名化」に触れている(注21)が、これに相当することが、勧告の原則4.6と、説明覚書の第28段落と第53段落で、次のように書かれている。

4.6 個人データまたは個人データの集合は、国内法が非統計目的での処理および伝達を防止するための適切な保護措置を提供する場合に限り、統計目的で突合または相互接続することができる。

28. 統計分野において識別データの分離によって大きく達成される匿名化は、保護を確保する主要な手段である。しかし、明らかに、それは常に必要というわけでもなく、また常に十分というわけでもない:

a. それは常に必要というわけではない:特に反復的な調査の文脈において、データを最初から、あるいはより長期的にも匿名化しない場合があり得る。しかし、これはデータへの違法なアクセスを防止するための追加的な予防措置によって相殺される。

b. それは常に十分というわけではない:理論的に匿名のデータが再識別される残余リスクが存在する場合がある。53.(略)a. 一部の国では、識別は、公共サービスで使用される公式に割り当てられた識別番号(個人識別番号、第24段落を参照)によって行われることもある。そのような番号がデータ対象者を直接的に識別することを許さない限りは、それらは本勧告の意味における識別データではない。

このように、統計目的での突合(matching)が許容されている。その理由は、続く第29段落(前掲)に「この関連において、統計処理そのものがデータ対象者にとって脅威となるのではなく……」と書かれているわけである。やはり言っていた通りなのだ。

第53段落に「一部の国では……」とあるのは、ノルウェーなどのことのようで、国民識別番号を用いて突合することもあり得るとされている。日本でいえば、マイナンバー、住民票コード、基礎年金番号、被保険者番号それ自体を用いるか、あるいはそれを変換した符号を用いて、突合を行うことが考えられる。

日本では、1970年代初頭の国民総背番号制反対運動からずーっと、突合自体が悪とされ、人物像を生成することが侵害であるかのように言われてきたが、そうではなく、関連性のないデータを含めた突合によって評価されて決定に用いられることが問題なのであり、決定に用いない限りは個人の権利利益は害されないのである。技術的に突合できなくする(識別子を別々にする)ことは、原則違反となる決定の目的で突合されることを未然に防ぐ効果があるわけだが、それは権利利益保護のための手段であって、目的ではないのである*31。

勧告の原則4.6が言う「非統計目的での処理および伝達を防止するための適切な保護措置」は、転々流通を防止する規制に加え、こうした変換符号による工夫を含むだろう。変換符号を用いた突合は日本でも既にNDBにおいて行われてきたが、これが許されるのは「氏名がないから個人情報でないので」ではなく、「個人データであるが統計目的であるから許される」と整理するべきである*32。それは「非統計目的での処理および伝達を防止するための適切な保護措置」のために、法の規制対象とする必要があるからである。GDPRが仮名化しても依然として個人データであると位置付けているのはこのためである。

「仮名化しても個人データであるとしつつ利用できるように制度を調整していく必要がある」(注13)という認識は、この勧告にも見られる。この話は、JILISレポートの解説パート「「匿名」概念と「個別データ」」に詳しく書いたので、それを読んでほしいが、ここでは、かいつまんで再解説しておく。

この1997年勧告の時点では、まだ「仮名化」の言葉が登場しておらず、現在で言う「仮名化」データも「匿名情報」も合わせて「匿名」概念で言い表されていた。それゆえに「真に匿名」との表現も出てきて、これが現在の「匿名情報」に相当する。その上で第27段落、第53段落で、以下のように記載されている。

27.(略)c. 匿名のもの(anonymous)に見える個別データ(individual data)(識別データを伴わないもの)が、それにもかかわらず場合によっては間接的に識別可能となることがある。これは、少なくとも一部のデータ対象者について、属性を示すデータ(年齢、性別、職業、居住地、家族状況など)を組み合わせることにより、実際に当該者の身元を発見することが可能となることを意味する。これが可能性として存在する場合、データは真に匿名(genuinely anonymous)とはみなされず、したがって保護されなければならない。

これは今日で言う、仮名化しても個人データである仮名化データのことを指している。「保護されなければならない」と指摘されている。やはり言っていた通りなのだ。

53.(略)b. 起草者らは、本勧告の文言において「匿名化」(anonymisation)という用語の使用を避けた。しかし、彼らは、勧告の適用の観点から説明覚書で明確にする価値があると考えた。匿名化は、個別データ(individual data)を様々なデータ対象者に氏名によって帰属させることがもはやないように識別データを消去することからなる(第21段落および第28段落を参照)。識別データの撤去は、場合によっては再識別(re-identification)に対する完全な保護を提供しない:開示のリスクを厳密にゼロリスクに常にできるわけではない。「許容可能なリスク」の定義の試みはさておき、匿名化の有効性は多分に相対的である(問題となる情報の性質、セキュリティ条件、匿名化の日付、処理の段階など)。

これも今日で言う仮名化のことを話しているが、「「許容可能なリスク」の定義の試みはさておき」とあるのは、平成27年改正の検討時に議論された「十分な匿名化」のような話であろう。定義のしようがないものであることが既に仄めかされている*33。このように、平成27年改正の検討時に議論されたようなことは、欧州では既に1997年に勧告にまとめられていたわけだ。

ここで、「個別データ(individual data)」という用語が使われているところに要注目である。この用語について、説明覚書の注20が以下のように述べている。

20) 勧告の起草者らは、「個別データ」(individual data)の概念が個人データと匿名データを包含し、すなわち識別された、識別可能な、またはそうでないかを問わず、特定の個人に関するあらゆる情報を対象とすることを考えた。しかし、本勧告は「個別データ」という用語を使用しておらず、したがってその定義も含まれていない。

この説明からすると、「個別データ」(individual data)は、個人データを仮名化した仮名化データのことだけでなく、初めから仮名データであるようなものを含むもの、すなわち、現在の日本法で言うところの「個人データ及び個人関連情報(個人関連情報データベース等を構成するものに限る)」に相当するもの、言い換えれば「個人に関する情報(個人に関する情報データベース等を構成するものに限る)」に相当するもの、のようである。私もそこまで対象を広げるべきと主張したこともあった*34が、この勧告では、起草者らはそう考えたものの合意に達しなかったのか、勧告本文でこの言葉は使用されていないと注記されている。

「個別データ」(individual data)は、「保護されなければならない」とは指摘されているものの、「personal data」に該当するのかについて言及がない。これはおそらく、当時の議論として、「personal data」の解釈をそこまで含めるべきだとの見解がある一方、反対する見解もある中で、統計目的の処理の過程における匿名化(当時の意味での)されたデータを(真の匿名化ではないので)何と呼ぶかが焦点となり、「個別データ」(individual data)という用語が提案されたものの、広くは受け入れられなかったのであろう。

仮名化(pseudonymisation)という用語は、この後に発展したもののようで、2016年7月23日の日記「ノルウェー法の「de-identified personal data」と「anonymous data」そして「pseudonymous data」並びに「indirectly identifiable data」を調べた(パーソナルデータ保護法制の行方 その25)」に書いていたように、遅くとも2001年のノルウェーの医療分野の法律で「pseudonymous health data」の語が使われていた*35。そしてドイツの連邦データ保護法(BDSG)に「pseudonymisieren」の定義語が入ったのは2003年改正であった。

この辺りの変遷の経緯に興味深い記録がありそうだが、未調査であり、今後調べたい。

以上のように、Suica事案発覚から足掛け12年て私が到達した理解は、1997年までに欧州で整理済みだったのだ。私がこれだけアピールしていても誰も「これに書いてあるよ」と言ってくれなかったわけで、誰も見ていなかったのだろう。なんということだ。もっと早く気づいていれば……*36

まだ残りの話があるので、続ける。

次に、JILISレポートの解説パートでは取り上げなかったが、機微データ(sensitive data)(EU法で言う「特別カテゴリ」、日本法で言う「要配慮個人情報」)について、追加の検討を少し。

1997年の欧州評議会のこの勧告は、機微データについて、一次収集については、必要性を要求し、「目的をより慎重に特定する」とか、国内法で「より厳格な保護措置を規定しなければならない」といった記載があるものの、機微データの統計目的の二次利用の可否について、語っていない。その点、1995年のデータ保護指令では、特別カテゴリのデータの処理(Article 8: The processing of special categories of data)について、ホワイトリストに列挙された場合の他は処理を禁止するよう加盟国に求めているが、統計目的や科学研究の目的がリストに挙げられていなかった。1997年の欧州評議会勧告がこの点で歯切れが悪いのはそのせいかもしれない。これが、後の、GDPRの規定(Article 9: Processing of special categories of personal data)では、9条2項(j)で明示的に認めるようになっている。この辺りの経緯も調べると興味深いことが判明しそうだが、未調査である。

さしあたり、GDPRの9条2項(j)について、一般個人データとどう違うのかを、Claude 3.7 Sonnetに尋ねてみたところ、「通常のデータより同意の基準が厳格で、統計目的での利用であっても明示的同意が必要なケースがあります」などとテキトーなことを答えてきたので、加盟国の国内法で同意を要求している国があるかを調べさせたところ、「検索結果からは、特別カテゴリデータの統計目的利用において明示的に同意を求めることを必須としている加盟国の具体例は明確に特定できませんでした。」という返事だった。この辺りはちゃんと確認しておきたいところ。

「一般的決定」と「個別的決定」

そして最後に、最も重要で難解な、JILISレポートで最初に取り上げている「「個別的決定」の概念」である。

2020年の国民視点のデータヘルス法制WG(注16)で一次利用と二次利用が混同されてしまったように、また、2022年の規制改革で「決定利用が禁止されてしまえば統計により知見を得ても使うことができないのでは?」(注23)との疑念を持たれてしまったように、決定利用の禁止が何を禁止する話なのかの理解が、なかなか伝わらない。2023年7月1日の六本木会議オンライン「緊急アピール」(注25)では、「二次利用がいつの間にか一次利用にされてしまう」的な説明をしているが、それで腹落ちできた視聴者は少なかったのではないか。

欧州評議会の1997年勧告は、説明覚書で、「一般的決定」と「個別的決定」の語を用いて、この区別の重要性を真っ先に説明している。やはり、30年前の当時も、ここの混同が理解の障壁となっていたのであろう。説明覚書の説明もあまり上手ではなく、わかっている人が読まないと理解できないと思われる。それゆえに、JILISレポートで解説を加える必要があると考えたのだ。

説明覚書は、まず、統計結果がどのように利用されるかについて、「計画立案と意思決定の支援の目的」で利用されるとしながら、そこでいう「決定」には、⼀般的決定(general decisions)と個別的決定(individual decisions)があると区分し、「統計⽬的で収集・処理された個⼈データは、前者の種類の決定にのみ使⽤することができる。」と指摘している(第13段落)。

「一般的決定」は、説明覚書第13段落で「法律、評価の尺度、予防接種キャンペーン、輸送の組織、設計図の作成、生産開始など」と例示され、「個別的決定」は「許可または除外、課税、給付、報酬など」と例示されている。これだけを見ると、個人に対する決定ではないものを「一般的決定」と呼んでいるようにも見える(そういう分類方法はあり得る話でこの用語で相応しいように思える)。しかし、段落のその直後に、「このような一般的決定は、確かに特定の者に対して(有利または不利な)特別な影響を及ぼすことがある。」とも書かれているので、影響があるからにはそれは個人に対する決定である。例えば、小中学生の何らかの個人データの統計分析の結果から得られた知見に基づいて、地域毎の小中学校の給食費に差を付けたとしよう。これは「一般的決定」であるが、当該小中学校に通う児童に影響を及ぼすのであるから、当該個人に対する措置または決定に当たる。したがって、「一般的決定」には、個人に対する決定でない決定と、個人に対する決定の両方が含まれるということだろう。

もう一方の「個別的決定」は、常に個人に対する決定であるが、「一般的決定」との違いは、その統計の入力に与えた個人データに統計結果を当てはめて当該個人データの本人に対する決定を行うものという点にある。つまり、反対に「一般的決定」では、それを行わないということである。統計結果の利用は何かしらのデータへの当てはめを伴うので、どのデータに当てはめるかの違いということになる。このことを、説明覚書の先ほどの段落の続きは、以下のように説明している。

13. 計画立案と意思決定の支援は、二種類の決定を下す責任を負う公務員にとって関連のある目的である:一般的決定(general decisions)(法律、評価の尺度、予防接種キャンペーン、輸送の組織、設計図の作成、生産開始など)と個別的決定(individual decisions)(許可または除外、課税、給付、報酬など)である。統計目的で収集・処理された個人データは、前者の種類の決定にのみ使用することができる。このような一般的決定は、確かに特定の者に対して(有利または不利な)特別な影響を及ぼすことがある。しかし、統計的な集合の中に溶け込むこととなる個人情報を提供した事実と、個別的決定による影響を受ける事実との間には、いかなる関連もあってはならない。このような関連を防ぐため、規範的規則は、しばしば統計データを扱うサービスと個別の決定を行うファイルを扱うサービスとの間の組織的分離によって補完される(職務の機能的分離の原則)。

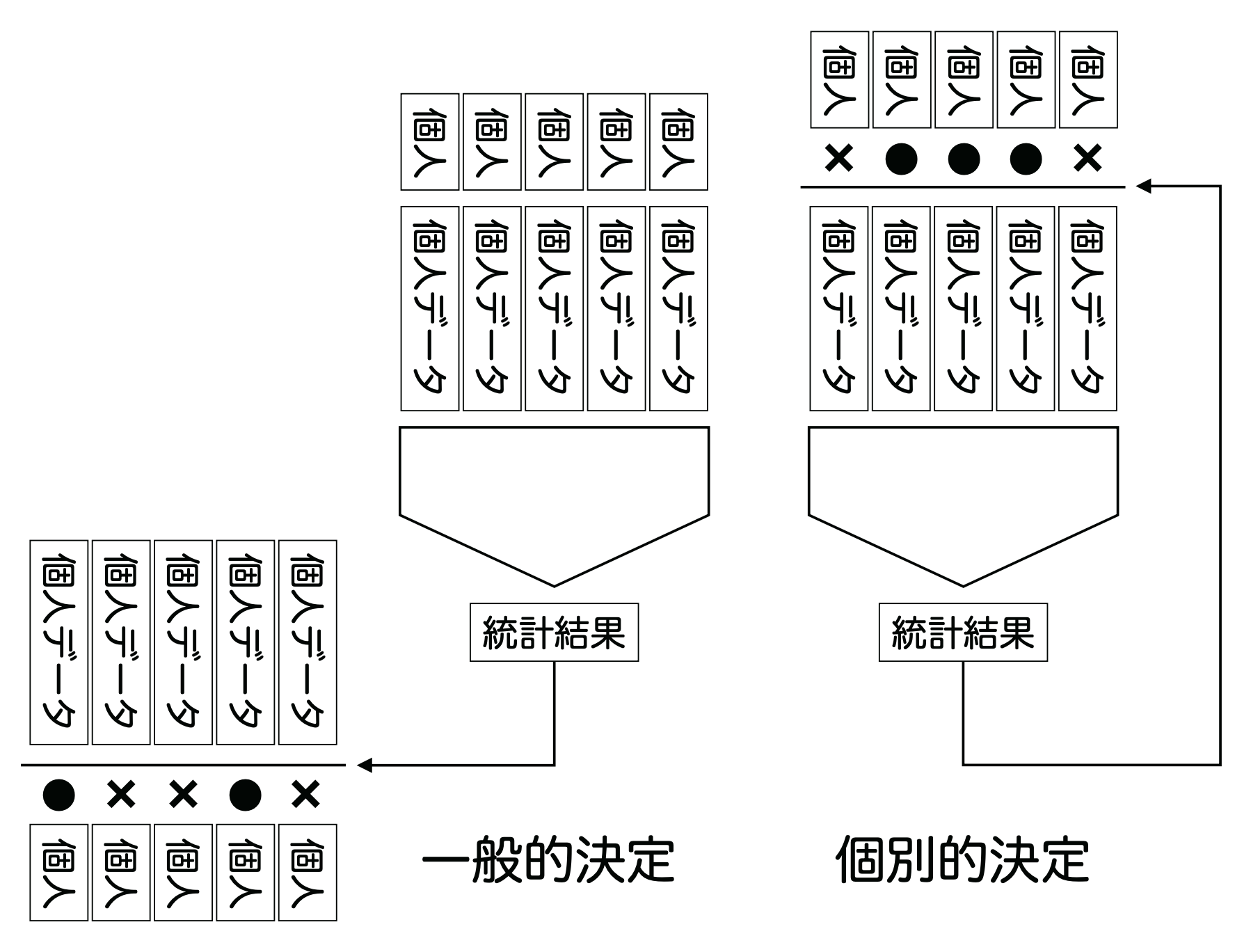

私のJILISレポートの解説では、模式図を作成して、以下のように説明してみた。

図1: 一般的決定と個別的決定

図1: 一般的決定と個別的決定「個別的決定」の概念

説明覚書は、まず、序論「A.問題点」第3段落で、「当該データが収集⽬的から逸脱して使⽤され、個⼈に関する⽬的(purposes relating to individuals)のために使⽤されるリスクがある。これは例えば、統計が⾏政や警察と接触する場合に、統計⽬的で収集されたこれらのデータを個別の判断や決定(individual judgements and decisions)に使⽤したくなる可能性がある場合などである。」との懸念を提示し、「B.統計の特徴」第10段落で、「個⼈データの個別的利⽤(individual use)と集合的利⽤(collective use)との間に基本的な区別を設ける必要がある。」と指摘している。

「個別的利⽤」は、「個別化された⽬的を持ち、特定の⼈についての具体的な情報を得ること、あるいはその⼈に不利益(detriment)または利益(benefit)をもたらす厳密に個別的な決定を下すこと̶̶例えば⾏政的、医療的、法的、その他の決定̶̶を⽬的とする。」と説明されており、不利益決定に限らず利益決定も含められている。

その上で、統計結果がどのように利用されるかを整理して、「計画立案と意思決定の支援の目的」で利用されるが、そこでいう「決定」には、⼀般的決定(general decisions)と個別的決定(individual decisions)があるとして、「統計⽬的で収集・処理された個⼈データは、前者の種類の決定にのみ使⽤することができる。」と指摘している(第13段落)。

ここで、「一般的決定」と「個別的決定」の違いを解説すると、両者の違いは、統計の入力に用いられた個人データに対する当てはめが行われるか否かである(図1)。一般的決定は、統計に基づいて個々人を異なって扱うことを伴う場合(例えば、統計で得られた医学的知見に基づく治療の実施)と、伴わない場合(例えば、人口統計に基づく予算額の決定)があるところ、前者の場合において、その決定に際して、統計結果を当てはめる参照先の個人データが、新たに収集されるものであるか、または、その統計の入力に用いられた個人データとは別の既存の個人データである場合を指しており、他方の個別的決定は、統計の入力に用いられた個人データを参照して統計結果を当てはめる場合を指している。

説明覚書の第13段落は、このような理解を前提に、「一般的決定は、確かに特定の者に対して(有利または不利な)特別な影響を及ぼすことがある。しかし、統計的な集合の中に溶け込むこととなる個人情報を提供した事実と、個別的決定による影響を受ける事実との間には、いかなる関連もあってはならない。」と指摘して、一般的決定に使用することは許され得るが8、個別的決定に使用することは許されない旨を主張している9。

2023年の規制改革の際にも、模式図で説明しようとしていたが、医療データの二次利用という具体的なケースで説明していたので、煩雑になりすぎてうまくいかなかった。それが、このように、欧州評議会の勧告が「一般的決定」と「個別的決定」という普遍化した説明用語を与えてくれたので、説明しやすくなった。どうだろう、これでおわかりいただけるだろうか?

ここで、注8と9(JILISレポートの脚注)に着目してほしい。まず、注8だが、

8 その決定が適切なものかは、また別の問題であり、使用するデータ項目が決定の目的に対して関連するもの(relevant)であるかが問われるが、この勧告ではその観点は検討外となっている。

と書いたように、「一般的決定」であっても、個人データに当てはめて決定する場合には、それが常に許されるわけではなく、改めてデータ保護法の基本原則に従う必要がある。特に関連(relevant)性の要求を満たさなければならない。

先ほどの小中学校の給食費の例で言えば、児童らの地域別の成績を統計量に集計して、平均成績の低い地域の小中学校について給食費を半額にしたとしたら、これは「一般的決定」であるけれども、給食費の決定という「決定」の目的に対して「平均成績の低い地域の学校に通学している」というデータ項目は「関連性」があるのか?が問われる。

続く、注9は、

9 佐久間淳『データ解析におけるプライバシー保護』(講談社、2016)90頁に書かれている「保険料の値上げ」の例題は、ここでいう一般的決定の統計利用を説明したものとして理解できる。

と書いたように、佐久間先生の2016年のご著書を参照している。この本は平成27年改正直後に出版されたもので、平成27年改正に際しての議論を通じての佐久間先生なりの到達点を示されたものだろう。同書の90、91頁には、以下のことが書かれている。

問題7.1 (論文出版)

Xさんは遺伝的特徴Aをもち、かつ肺がんを患しているとしましょう。このような論文の出版はXさんのプライバシーを侵書したといえるでしょうか?

Xさんは疫学者に、「私は遺伝的特徴Aをもち、かつ肺がんである」という情報を提供し、結果として「遺伝的特徴Aと肺がんの発症は有意に関係する」という統計的検定の結果が一般公開されました。一般公開された情報はXさんの提供情報とよく適合しており、Xさんの秘密の情報が公開されてしまったように感じられます。しかし「遺伝的特徴Aと肺がんの発症は有意に関係する」という情報は、Xさんが疫学者に情報を提供しようとしなかろうと、(ほとんど同じ確率で)公開されたはずの情報ですから、プライバシーの侵害とは判断しません。次に以下の問題を考えます。

問題7.2 (保険料の値上げ)

Xさんは、遺伝的特徴Aをもち、かつ肺がんは罹患していませんが、遺伝的特徴Aをもつことを自分が加入している民間の医療保険会社に伝えていたとしましょう。その医療保険会社はこの論文の結果を受け、遺伝的特徴Aをもつ被保険者の保険料を値上げしました。このような保険料の値上げは、Xさんのプライバシーを侵害したといえるでしょうか?

Xさんは疫学者に「私は遺伝的特徴Aをもつ」という情報を提供しました。医療保険会社は論文から「遺伝的特徴Aの有無と肺がんの発症は有意に関係する」という情報を得て、この遺伝的特徴をもつ者の医療保険料を値上げしたとします。Xさんの立場からすれば、自身がデータを提供した論文によって保険料が値上がりしたわけですから、直接的な不利益を被ったといえるでしょう。しかし、それでもやはり、プライバシー侵害が起こったとは考えません。そのような値上がりは、Xさんが疫学者に自分の情報を提供しようとしなかろうと、(ほとんど同じ確率で)起こったはずだからです*2。

佐久間淳『データ解析におけるプライバシー保護』(講談社、2016)90頁

「問題7.1」で設定されている状況「Xさんは疫学者に、「私は遺伝的特徴Aをもち、かつ肺がんである」という情報を提供し、結果として「遺伝的特徴Aと肺がんの発症は有意に関係する」という統計的検定の結果が一般公開されました。」は、疫学者への提供についてXさんの同意がある想定なのかもしれないが、ここでは、同意なく二次利用していると想定しよう。それでも、Xさんの参加があろうがなかろうが「ほとんど同じ確率で」結果が起きているので、Xさんの権利利益侵害はない。

続く「問題7.2」は、その一般公開された結果が、Xさんの保険料の算定に使われており、Xさんの「遺伝的特徴A」という、Xさんの個人データのデータ項目に統計結果の当てはめが行われている。その統計結果は、Xさんの個人データを含めて計算されたものであるが、当てはめは保険会社という別のシチュエーションで行われているので、これは先の図1の「一般的決定」であって「個別的決定」ではない場合の例である。

この場合も、疫学者への提供にXさんの参加があろうがなかろうが「ほとんど同じ確率で」結果が起きているので、疫学者への提供についてXさんの権利利益侵害はないということになる。

このことが、1997年勧告の説明覚書では、先ほどの「統計的な集合の中に溶け込むこととなる個人情報を提供した事実」と説明されているのである。一般的決定には「統計的な集合の中に溶け込む」形で影響するが、溶け込んでいるので元のデータは結果に影響をほとんど与えていない*37。それに対して、個別的決定にはダイレクトに参照されるので、「個別的決定による影響を受ける事実との間には、いかなる関連もあってはならない」とされるのである。

このように、佐久間本のこの例題は、まさしく、1997年勧告の「一般的決定」の概念を説明したものになっていた。

なお、佐久間本の91頁「*2」の注を見ると、以下の補足がある。

*2 倫理的な観点からは、遺伝的特徴によって保険料を変化させてよいかどうかは慎重な議論が必要な問題です。米国には健康保険や雇用において、遺伝情報に基づく差別的な扱いを禁止する遺伝情報差別法があります、ここでは、プライバシー保護の問題と差別の問題は別の問題であると考えています。プライバシーの侵害は起こっていなくても。差別的扱いが見られることはありえます。

佐久間淳『データ解析におけるプライバシー保護』(講談社、2016)91頁

この補足は、先ほどの私のJILISレポートの注8と同じポイントを突いている。一般的決定であっても、改めてデータ保護法の基本原則に従う必要があるのである。保険料の算定という決定の目的に対して遺伝的特徴というデータ項目の「関連性」が問われるわけである。

佐久間先生は、ここで、差別の問題はプライバシー保護の問題とは別の問題と捉えているが、このような意味での「差別」の問題(決定の公平性の確保)は、データ保護法(個人情報保護法)が保護しようとする核心的保護利益の本丸なのであり*38、日本ではそのことが理解されていないわけである。もっとも、「データ保護法=プライバシー保護法」ではないという意味で「プライバシー保護の問題とは別の問題である」というのは真である。しかし、欧州評議会条約108号では、GDPRとは異なって、まだ「privacy」の語を使っていた時期に制定されたものであるため、今回の勧告の説明覚書が述べているように、個別的決定に用いない保護措置があれば、条約9条3項が言う「データ対象者のプライバシーの侵害のリスクが明らかに存在しない場合」に当たるという説明がなされている。もっともそこは、「プライバシー」の語をどう用いるか次第の話である*39。

佐久間先生のこの例題がこの論点をズバリ説明していることに気づいたのは、2022年末だった。翌年のCSS福岡の懇親会の席で「いやーわかりましたよー!」と佐久間先生に話しかけたのを覚えている。やっとこのように紹介することができた。

さて、このような非常に大掛かりな概念の理解が、はたしてどれだけの人に伝わるだろうか。どれだけ説明してもわかってもらえないような気がして悲しくなってくる。

大規模言語モデルはわかるだろうか。Claude 3.7 Sonnetに、勧告の説明覚書の原文と、私のJILISレポートの解説パートだけを与えて、質問してみたのが以下である。

- 導入部分の文脈設定: 欧州評議会の勧告の背景と、なぜ2025年の日本の議論に関連するのかを明確に説明しています。特に個人情報保護委員会の現在の検討状況との関連付けが読者にとって価値があります。

- 重要概念の明確な解説: 「個別的決定」と「一般的決定」の違いを図解入りで説明している点が非常に分かりやすいです。抽象的な概念を具体的に理解できるようになっています。

- 引用と解説のバランス: 原文からの引用と、その意義についての解説がバランス良く配置されており、読者は原文の内容とその現代的解釈の両方を理解できます。

- 批判的検討: 単に勧告を紹介するだけでなく、「比例性とデータ品質の原則」の部分では批判的な視点も提供しており、学術的な深みを与えています。

- 現在の議論への応用: 「突合処理への識別データの使用」などのセクションでは、勧告の考え方が現在の日本の法的議論にどう適用できるかを具体的に示しています。

レポート全体として、各セクションが明確に区分され、重要なポイントが強調されており、読者が段階的に理解を深められる構成になっています。専門的な内容ですが、可能な限り明確に説明されており、データ保護法制の専門家だけでなく、この分野に関心を持つ実務家にも有益な情報を提供していると思います。

読者にとって特に有用なのは、この勧告が強調する「統計目的の場合には個人の権利利益への影響が少ない」という考え方と、その理由の解説部分です。これは現在の日本の議論において重要な視点を提供しています。

現在の説明は、「一般的決定」と「個別的決定」の違いが「統計の入力に用いられた個人データに対する当てはめが行われるか否か」という核心を捉えています。また図で示されている矢印の流れや、○×マークの意味も本文から類推できます。

しかし、この区別がなぜ重要なのかについては、もう少し明確に強調すると良いかもしれません。具体的には:

- この区別が個人の権利利益保護の観点から決定的に重要である点をより明確にする

- 個別的決定の場合、統計のために提供した自分のデータが自分自身への決定に使われることになり、それが権利利益侵害リスクの核心である

- 一般的決定の場合は、統計入力元の人とは別の人に統計結果を適用するため、入力元の人の権利利益には影響しない

- 現在の日本の議論との関連性をより具体的に示す

- 本人同意なき第三者提供が許される「統計作成」が、なぜ権利利益への影響が少ないと評価されるのかの理論的根拠として、この区別が決定的に重要である点

- 図の視覚的要素(矢印、○×マーク)が具体的に何を表しているのかを簡潔に説明する一文があると、図の理解がより深まるでしょう

この区別の重要性は本文全体を通じて繰り返し示されていますが、図1の解説部分でより端的に「この区別こそが統計目的の個人データ利用において本人同意が不要とされる根拠となる」という点を強調すると、読者にとって一層明確になると思います。

一般的決定の核心的特徴は、統計のために個人データを提供した人(データ対象者)と、その統計結果を適用される人が別々であるという点です。このため、以下の理由で問題が生じません:

- 利益侵害の連鎖の切断:説明覚書の第13段落で明確に述べられているように、「統計的な集合の中に溶け込むこととなる個人情報を提供した事実と、個別的決定による影響を受ける事実との間には、いかなる関連もあってはならない」とされています。つまり、データを提供した人が、その提供したデータに基づく決定によって影響を受けることがないため、プライバシー侵害のリスクが遮断されています。

- 目的の適切な分離:統計処理の結果を一般的な知見として活用することは、データが本来収集された統計目的と両立します。これは統計が本来、集団現象を特徴づけるためのものであるという基本的性質に合致します。

- 社会的有用性とリスクのバランス:統計結果を新たに収集されたデータや別の既存データに適用することは、社会的に有用な知見の活用であり、元のデータ提供者にはリスクをもたらさないため、比例性の原則に照らしても許容されます。

- 個人の自律性の保護:データ対象者自身に対して統計結果が当てはめられない限り、そのデータ対象者の自己情報コントロール権や自律性は侵害されません。

これらの理由から、一般的決定では、統計目的で収集されたデータが「非統計目的に流用される可能性」という脅威(第29段落)が存在せず、したがって本人同意なき第三者提供が許容され得るのです。この区別は、データ保護法制における統計目的の特別な扱いの理論的根拠として極めて重要です。

統計目的のデータ保護の文脈で真に重要なのは、「データを提供した本人」と「統計結果が適用される人」の関係性です。一般的決定では、この二者が異なるという点が決定的です。

説明覚書の第13段落は核心を突いています:「一般的決定は、確かに特定の者に対して(有利または不利な)特別な影響を及ぼすことがある。しかし、統計的な集合の中に溶け込むこととなる個人情報を提供した事実と、個別的決定による影響を受ける事実との間には、いかなる関連もあってはならない。」

つまり:

- 権利利益保護の対象の明確化:個人データ保護法制が保護するのは「データを提供した本人の権利利益」です。その人自身に対して決定が適用されない限り、保護法益への侵害は生じないという考え方です。

- リスクの所在の特定:第29段落で明確に示されているように、「統計処理そのものがデータ対象者にとって脅威となるのではなく、それが基づくデータが非統計的目的に流用される可能性があるという事実が脅威となる」のです。

- 規制領域の区分:一般的決定において統計結果を新たな個人に適用する際の決定の適切さは、注8にあるように「その決定が適切なものかは、また別の問題であり...この勧告ではその観点は検討外となっている」と明記されています。これは医療倫理や消費者保護など別の規制領域の問題とされています。

この考え方の重要性は、データの流通・活用を過度に制限せずに、真に保護すべき権利利益(データ提供者自身への影響)に焦点を当てた効率的な規制を可能にする点にあります。統計結果の「社会的活用」と「個人の権利保護」のバランスを図る上で、この区別は極めて重要な理論的基盤を提供しています。

JILISレポートの注8が示す重要なポイントを見落としていました。一般的決定における個人への当てはめの適切さの問題は、「別の規制領域」ではなく、まさにデータ保護法の範疇であり、具体的には「データ品質の原則」に関わる問題です。

この点について正確に説明すると:

- 一般的決定においては、統計結果を別の個人に当てはめる際に、「使用するデータ項目が決定の目的に対して関連するもの(relevant)であるか」という「関連性」の要件が問われます。

- これはデータ保護法における「データ品質の原則」の一部であり、注18、19で参照されている文献が詳述しているように、個人データに基づく評価・決定が適切なものとなるための要件です。

- しかし、この勧告自体はこの観点を検討対象外としています。なぜなら、勧告は統計目的の処理自体に焦点を当てており、統計結果の後の利用については扱っていないからです。

この区別の重要性は、統計目的の処理それ自体は個人の権利利益を侵害しないという前提に立ちつつも、その統計結果の後の利用については、なお「関連性」などのデータ品質要件が適用されるべきであるという点にあります。このように、データ保護法の範疇内で、処理の段階によって適用される原則が異なることを理解することが重要です。

この点について JILISレポートでは明示的に扱われていませんが、勧告の考え方から解釈すると:

- 決定的な区別点: 重要なのは、その人の「特定の個人データ」と「それに基づく決定」の間の直接的な連鎖があるかどうかです。説明覚書の第13段落の「統計的な集合の中に溶け込むこととなる個人情報を提供した事実と、個別的決定による影響を受ける事実との間には、いかなる関連もあってはならない」という記述がこれを示唆しています。

- データの参照プロセス: 個別的決定では、その人自身の提供したデータを参照して統計結果を当てはめますが、一般的決定では、たとえその人が統計データを提供した人であっても、その事実とは無関係に、新たに収集された別のデータや別の既存データに統計結果を適用します。

- 個人識別子の扱い: 個別的決定では、個人識別子によって、入力データと決定対象を直接リンクさせますが、一般的決定ではそのようなリンクはありません。

つまり、同一人物が統計データの提供者であり、後に統計結果の適用対象者になる場合でも、この2つの事象が直接リンクしていない限り、「一般的決定」と見なされます。データが「統計的集合の中に溶け込む」というプロセスを経ることで、個人との直接的な連鎖が切断されるという考え方です。

これは結局、データ保護法の真の保護対象は「個人データの流用による直接的な権利利益侵害」であり、統計という「集合化」のプロセスを経ることでその直接的連鎖が切断されるという考え方に基づいています。

私:注9にある「佐久間淳『データ解析におけるプライバシー保護』(講談社、2016)90頁」はこれです。参考になりますか。

特に重要なのは問題7.2(保険料の値上げ)の事例です:

- これは典型的な「一般的決定」の例で、統計的知見(「遺伝的特徴Aと肺がんの発症は有意に関係する」)を別の個人(保険加入者)に適用するケースです。

- 興味深いのは、Xさん自身がデータを提供し、そのデータを含む統計分析の結果が保険料値上げに使われ、Xさん自身が影響を受けるという状況です。つまり「データ提供者」と「統計結果の適用対象者」が同一人物の場合です。

- 本文で「Xさんの立場からすれば、自身がデータを提供した論文によって保険料が値上がりしただけですから、直接的な不利益を被ったといえるでしょう。しかし、それでもやはり、プライバシー侵害が起こったとは考えません」と明確に述べられています。

この事例は先ほどの質問に対する直接的な回答を提供しています:たとえデータ提供者と統計結果の適用対象者が同一人物であっても、「統計的集合の中に溶け込む」というプロセスを経ることで、個人データとそれに基づく決定の間の直接的連鎖が切断され、「一般的決定」と見なされます。そして、そのような場合はプライバシー侵害とは判断されないという考え方です。

この資料は、JILISレポートの図1で示された「一般的決定」と「個別的決定」の区別の重要性と、その実際的な意味を具体例で明確に示しており、大変価値のある参考資料です。

見える範囲では「そのような値上がりは、Xさんが疫学者に自分の情報を提供し」と続いていますが、その後の部分は画像が切れているため読み取れません。

この続きの文脈は、なぜプライバシー侵害と考えないのかの理由付けを説明している可能性が高く、議論の核心部分だと思われます。おそらく「一般的決定」と判断する理論的根拠がより詳細に説明されていると思われますので、もし可能であれば、その続きの部分も確認できると理解がより深まると思います。

右上には以下のテキストが続いています:

うとしなかろうと、(ほとんど同じ確率で)起こったはずだからです*2。

プライバシーが侵害されたかどうかは主観的な側面も含み、判断の難しい問題ですが、ここでは両者ともにプライバシーの侵害は起こっていないものと考えられます。

これは非常に重要な説明です。「一般的決定」がプライバシー侵害と見なされない理由が明確に述べられています:

統計結果に基づく決定(この場合は保険料値上げ)は、Xさん個人が情報を提供したかどうかにかかわらず、「ほとんど同じ確率で起こったはず」だからだというのです。

これは、個人の提供データと決定の間の因果関係や直接的連鎖が存在しないことを意味します。統計的集合の中で個人データが希釈され、特定個人の影響力が失われるという統計処理の本質的特徴を示しています。

この説明は、JILISレポートの図1とその説明の理論的根拠をさらに明確にするものであり、統計目的の処理が個人の権利利益を侵害しないという考え方の核心を捉えています。

*2 倫理的観点からは、遺伝情報によって保険料を変更することができるかどうかは議論を要するでしょう。米国には遺伝情報差別禁止法において、遺伝情報に基づく差別を禁止する遺伝情報差別禁止法があります。ここでは、プライバシー侵害の問題と差別の問題は別の問題であると考えています。プライバシーの侵害は起こっていなくても、差別的な扱いが見られることはあります。

この注釈は非常に重要で、「一般的決定」がプライバシー侵害に当たらないとしても、それが別の法的・倫理的問題を引き起こす可能性があることを指摘しています。特に:

- プライバシー法制と差別禁止法制は別の法的枠組みである

- 統計的処理自体はプライバシー侵害に当たらなくても、その結果の使用は別の法規制の対象となり得る

- データ保護法の範囲と限界を示している

この注釈は、JILISレポートの注8で言及されている「その決定が適切なものかは、また別の問題」という点を補強するものであり、データ保護法の保護対象の境界を理解する上で貴重な視点を提供しています。

おっしゃる通り、データ保護法の主目的の一つは、決定の目的に対して関連性のない(not relevant)データに基づく決定から個人を保護することであり、そのような関連性を欠いた決定が実質的に「差別」を構成するという理解は極めて重要です。

JILISレポートでも注18、19で参照されている文献で論じられている「データ品質の原則」はまさにこの点に関わっています。ETS 108条約の第5条や、その後のGDPRにおける「十分で(adequate)、関連性があり(relevant)」という要件は、不適切な(関連性のない)データに基づく決定から個人を保護するための核心的要素です。

佐久間氏の書籍では「プライバシー侵害の問題と差別の問題は別」と区別していますが、データ保護法の体系的理解においては、これらは密接に関連しており、実質的には同じ法目的(不当な決定からの保護)を達成するための異なる側面と見ることができます。

欧州評議会の勧告は統計目的の処理そのものに焦点を当てているため、この側面が十分に扱われていませんが、統計結果の適用においても「関連性」の要件が依然として重要であることは、データ保護法の理解において決定的に重要です。

この視点は、データ保護法を単なる「プライバシー保護」の枠を超えて、「不適切なデータに基づく決定からの保護」という広い文脈で捉え直すことの重要性を示しています。

これは図1にも表現されていると読み取れます:

- 左側(一般的決定)では、「統計結果」から矢印が出て、新たな「個人データ」群に適用されています

- この新たに適用される「個人データ」の処理自体について、別途、データ保護法の適法性要件(同意や他の法的根拠)が満たされているはずです

この二段階構造が重要です:

- 統計処理はデータ対象者のプライバシーを侵害しない(理由:集合化による個人との連鎖の切断)

- 統計結果の後の適用段階では、適用対象となる個人データについて別途適法性が確保されている

言い換えれば、統計結果を適用して個人に対する決定を行う場合、その決定のための個人データ処理は「新たな処理」として扱われ、データ保護法の全要件(適法性、透明性、データ品質など)に従う必要があります。

このように、一般的決定においては二重の保護メカニズムが機能しているため、統計目的の処理に特別な扱いを認めても、個人の権利保護が損なわれることはないという理解が成り立ちます。

「一般的決定」と「個別的決定」の区別に関するまとめ

JILISレポートの図1が示す「一般的決定」と「個別的決定」の区別は、統計目的の個人データ処理に関する重要な理論的基盤を提供しています。

基本的な違い

この区別の核心は、「統計の入力に用いられた個人データに対する当てはめが行われるか否か」にあります。

- 個別的決定:統計のために提供した個人のデータを参照して、その同じ個人に統計結果を当てはめる

- 一般的決定:統計のために提供した個人とは別の個人、または新たに収集された個人データに統計結果を当てはめる

プライバシー侵害にならない理論的根拠

「一般的決定」がプライバシー侵害にならない理由は:

- 連鎖の切断:「統計的な集合の中に溶け込むこととなる個人情報を提供した事実と、個別的決定による影響を受ける事実との間には、いかなる関連もあってはならない」(勧告説明覚書第13段落)

- 集合化による影響の希釈:佐久間氏の例示では、個人が統計データを提供し、その統計結果が当人にも適用される場合でも、その影響は「(ほとんど同じ確率で)起こったはず」であり、個人の提供データと決定の間に明確な因果関係が存在しない

- 二重の保護メカニズム:統計結果を個人に適用する際には、その適用対象となる個人データの処理について、統計処理とは別に適法性が確保されているという前提がある

区別の重要性

この区別が重要である理由:

- 本人同意なき利用の理論的根拠:統計目的のために本人同意なく個人データを利用・提供することが許容される理論的根拠となる

- データ保護の真の目的:データ保護法の主目的は「決定の目的に対して関連性のない(not relevant)データに基づく不適切な決定から個人を保護すること」であり、その観点から「一般的決定」と「個別的決定」の区別は極めて重要

- 均衡のとれた規制:データ流通・活用の過度な制限を避けつつ、真に保護すべき権利利益に焦点を当てた効率的な規制を可能にする

この区別を理解することで、統計目的の個人データ処理が特別な扱いを受ける理論的根拠が明確になり、「統計作成」が本人同意なき第三者提供を許容する条件となり得る理由が明らかになります。

このように、概ねわかるようだが、誘導なしには難しいようだった。特に、JILISレポート注8の「関連性」の話と、佐久間本注9の「差別」との関係の話は、与えた資料中に説明がないので、プロンプトで説明して、言わせるしかなかった。連載論文と併せて読ませれば完全に理解するのではないかと思われるが、現在のClaudeでは入り切らない。このことは、人間の読者も同じで、それらの全体を把握しないと、勧告の核心の理解が難しいと思われる。

ところで、GDPRの前文162を改めて原文で読んでみると、

The statistical purpose implies that the result of processing for statistical purposes is not personal data, but aggregate data, and that this result or the personal data are not used in support of measures or decisions regarding any particular natural person.

となっていて、「this result」が「any particular natural person」に関する措置または決定を裏付けるのに使用されないと書かれているので、「一般的決定」であっても個人に対する決定に統計結果が利用されないという意味に読めてしまう。その解釈だと、統計分析しても使い所がない事態になりかねず、あり得ない話である*40。そのように読まれてしまうと、データ利活用を推進したい人たちに「決定利用禁止なんて受け入れられない」と誤解させてしまう。

その点、1997年勧告ではもっと精緻に書かれていた。原則4.1の原文は次のようになっている。

4.1 Personal data collected and processed for statistical purposes shall serve only those purposes. They shall not be used to take a decision or measure in respect of the data subject, nor to supplement or correct files containing personal data which are processed for non-statistical purposes.

「they」は冒頭の「統計目的で収集・処理されたpersonal data」を指し、「the data subjectに関する決定または措置を講ずるために使用してはならない」となっているので、「the data subject」は冒頭の「personal data」の本人を指している。したがって、これは「個別的決定」を問題にしているのであって、「一般的決定」における「be used to take a decision or measure」について述べているものではないと、明確に読解できる。

1995年のデータ保護指令ではどうだったかを確認してみると、まず、13条2項では、

2. Subject to adequate legal safeguards, in particular that the data are not used for taking measures or decisions regarding any particular individual, Member States may, where there is clearly no risk of breaching the privacy of the data subject, restrict by a legislative measure the rights provided for in Article 12 when data are processed solely for purposes of scientific research or are kept in personal form for a period which does not exceed the period necessary for the sole purpose of creating statistics.

となっており、「any particular individual」とあるが、ここは開示等請求の権利制限の規定なので、「the data」が請求対象データであることは明らかなので、そのデータが措置または決定を講ずるために使用されないという話であり、誤解の余地はない。次に、前文29の原文は次のようになっている。

(29) Whereas the further processing of personal data for historical, statistical or scientific purposes is not generally to be considered incompatible with the purposes for which the data have previously been collected provided that Member States furnish suitable safeguards; whereas these safeguards must in particular rule out the use of the data in support of measures or decisions regarding any particular individual;

ここも、「any particular individual」となっているが、使用を問題にしているのは「the data」であり、「have previously been collected」なもの(二次利用しようとしている元の一次利用データ)なので、統計の入力に用いる個人データを指すことになり、この文が個別的決定を問題としていることは明らかだろう。

こうして比べてみると、GDPRの前文162がまずいのは、「this result or the personal data are not used in support of ……」と、「the personal data」だけでなく、「this result」(=「the result of processing for statistical purposes」)まで、使用しないものに入れてしまっているところだろう。要件から理由に変えようとして(注2)おかしくなったのだろうか。EUももはやわかっている人がいないのではないかと心配になる。立案から成立までの過程で変化していないか、あとで調べてみる。

最後にもう一点。

勧告の原則4.1には、こう書かれている。

4.1. 統計目的で収集・処理された個人データは、専らその目的のためにのみ使用されなければならない。これらは、データ対象者に関する決定または措置(decision or measure)を講ずるため、または非統計目的で処理される個人データを含むファイルを補完もしくは訂正するために使用してはならない。

この強調部からは、「情報的自己決定権」で有名な1983年西ドイツ国勢調査判決が想い起こされる。違憲とされた国勢調査法の規定の一つは、住民データの補完や訂正を用途としていた部分であった。国勢調査判決なのだから当然なのだが、統計の処理に関して争われたものだった。1997年の欧州評議会勧告も、そうした経緯を踏まえて整理されたものであろう。しかしどうだろうか、日本の法学は、情報的自己決定権についてこの憲法判例を研究するものは少なくないが、こうした統計処理のあり方との関係に注意を払っているものは見たことがなかった。個情委の今の「制度的課題」に役に立つ論考が見当たらない。

そこに今年、横山均先生(注16)が、自治実務セミナーで「なぜ、統計調査の調査票情報は行政目的で利用できないか」と題して、1983年西ドイツ国勢調査判決の分析も含めた横断的な検討の論考を発表された。関係者には刮目して精読いただきたい。

- 横山均「なぜ、統計調査の調査票情報は行政目的で利用できないか(1)」自治実務セミナー751号(2025)42-45頁

- 横山均「なぜ、統計調査の調査票情報は行政目的で利用できないか(2・完)」自治実務セミナー752号(2025)49-55頁

*1 これが理由だとの明記はなく、「統計目的は……を意味する」という文で、統計とはそういうものだという書き方になっていて、記載の趣旨がわかりにくくなっている。データ保護法が決定指向利益モデルで設計されていることを知っている者にとっては、理由を説明する文だなとすぐにわかるが、決定指向利益モデルを知らない者からすると、だから何?となってしまう。GDPRでは「決定」の概念が、この前文162の他には、22条の自動決定のところにしか現れないため、22条専用の概念だとの誤解が広く蔓延しており、ここの理解をいっそう難しくしている。

*2 データ保護指令では、これに相当する文は、前文29にあり、「個人データの歴史的、統計的または科学的目的での更なる処理は、加盟国が適切な保護措置を講じることを条件として、当該データが以前に収集された目的と一般的に両立しないもの(incompatible)とはみなされない。これらの保護措置は、特に、特定の個人に関する措置または決定(measures or decisions)を裏付けるためのデータの使用を排除するものでなければならない。」と書かれていて、明確に要件として記載されていた。それが、GDPRでは、上記の前文162の書きぶりに変更されているわけだが、その変更の趣旨は、理由を説明するつもりで書き直したようにも見える。ところが、これが理由であるとは明言できなかったのか、何を言いたいのかが一般にわかりにくくなっており、これが要件であることも見えにくくなってしまっている。また、データ保護指令では、本文中に「措置または決定(measures or decisions)」の文言が存在していた(13条2項、開示等の権利を制限(義務を免除)する国内法を認める規定)のだが、GDPRではそれが消えてしまった(より一般化されて11条になった)ため、「措置または決定(measures or decisions)」概念の重要性がいっそう見えにくくなっている。

*3 日本語でこれに言及した文献は見つからなかった。勧告と説明覚書の冊子は国会図書館に所蔵されている。周りに話を振ってみたが、聞いたことがないという反応だった。条約108号のことは(平成15年法以降では)個情法とは関係ないと思われていたフシがある。

*4 この顛末は2015年3月8日の日記「世界から孤立は瀬戸際で回避(パーソナルデータ保護法制の行方 その14)」に記している。今になってこれを読み直すと、だいぶ尻が青い。legitimate interestsのくだりは赤面ものだ。WP217を参照してターゲティングに触れているが、この時点ではまだ「決定」概念を知らない。EU法の基本原則もわかっていないので、legitimate interestsを適切に説明できていない。

*5 2013年11月「KOF2013」での講演の様子が日経BP「パーソナルデータ活用「セーフとアウトの明暗がはっきり」、産総研の高木氏」にレポートされている。この内容は、2013年の夏に鈴木正朝先生と集中合宿で解釈論と運動論の熟議を重ねて到達した整理だった。

*6 巷では「勝手に俺のデータを商売にするな」的な(嫌儲的な)意味で反発していた人々が大半であっただろうが、そのこと自体はこの法が問題視するところではないというのは当時からわかっており、それゆえに、事案が発生した際、どのように世論形成を促すべきか悩ましいところであった。この時は、ちょうど仕事の異動と重なったこともあり、表では多くを語っていない。WIREDの記事「JR東日本と日立、Suica利用データを販売、懸念の声も」にその時の私のツイートが記録されている。

*7 その時点での理解は、2015年11月の情報ネットワーク法学会のパネル第8分科会で提示しており、その記録は「情報ネットワーク・ローレビュー講演録編第15回研究大会講演録」に収載されている。

*8 この過程については、2017年7月22日の日記「匿名加工情報は何でないか・後編の2(保護法改正はどうなった その8)」を参照。

*9 その様子は、2016年11月29日の日記「医学研究等倫理指針見直し3省合同会議が迷走、自滅の道へ(パーソナルデータ保護法制の行方 その26)」にまとめており、その後どうなったかは、2017年5月13日の日記「医学系研究倫理指針における非識別加工情報の規定は無用の長物(研究倫理指針はどうなった その1)」の冒頭に書いたように、「懸念された事態は回避され、どうにか妥当なところに落ち着くかっこう」となった。これらの経緯と決着については、NBL No.1103(2017)の米村滋人「医学研究における個人情報保護の概要と法改正の影響」6頁以下と、横野恵「三省合同会議での議論と今後の展望」26頁以下が、的確に解説している。

*10 Annex BからTable B.1「Mapping of de-identification terminology to the prior art」を引用すると以下のように記載されており、2012年の英国ICOの資料(第3列)が仮名化も匿名化も一緒くたにして「匿名化」と称していたところ、2014年にEUの29条作業部会(第4列)がこれらを明確に区別した様子がわかる。第1列のISO 25237は、2008年の「Health informatics — Pseudonymization」のことであり、医療分野では2008年の時点で仮名化の用語(可逆的仮名化と不可逆的仮名化)が確立していたことがわかる(それが個人データのままであると解釈されるかどうかは別として)。第2列のISO 29100は、2011年の「Information technology — Security techniques — Privacy framework」のことで、第3行の可逆的仮名化(日本では「連結可能匿名化」と呼ばれた)を仮名化としつつ、第4行の不可逆的仮名化(日本では「連結不可能匿名化」と呼ばれた)を匿名化としていた(2018年に改訂されている)。私の日記では、前掲注9の2017年5月13日の日記で、「誤解のない用語としては、「連結仮名化」と「不連結仮名化」が相応しかった」と述べていた。

*11 「研究倫理指針はどうなった その1」の続きの「その2」を書く予定だったが、決着しつつあったので、書いていなかった。これもどこかに書き残しておかねば。

*12 仮名化すれば非個人情報であると法解釈を誤ってか、または、学術研究の適用除外を当てはめてか他の例外を適用して合法であると整理してか。

*13 この会議は、日本消化器内視鏡学会の「JEDプロジェクト」の一環で、診断画像を本人同意なく機械学習に用いることについて個人情報保護法上どう位置付けるかについて、AMEDから相談を受けたもので、第2回会合での講演を依頼されたのだったが、第1回の会合にオブザーバーで参加したところ、次世代医療基盤法を使うという話になっていたので、それは匿名化しないと使えないから画像には適用できませんよ(匿名化を仮名化と取り違えている)と指摘したところ、どこかの反発を買ったようで、次の回の私の講演は、内視鏡学会関係者だけでやる(AMEDやNIIほかは参加しない)ことになり、会場もAMEDの外に変更することになったと内視鏡学会の先生から事情の説明を受けた。私の講演の内容は、医学系指針の迷走ぶりを整理し、匿名加工情報の解釈の混乱ぶりとその決着の様子を紹介し、仮名化しても個人データであるとしつつ利用できるように制度を調整していく必要があることを示して、当時の現行法でも学術研究の適用除外で整理可能だが(NBL No.1103 17頁を参照している)若干の無理があるので制度改正を提案するもの(前掲注7の整理を発展させたもの)であった。内容は皆さんに納得して頂け「大変わかりやすかった」との反応があったが、結局、その方向性で進むことはできないと考えられたのか、その後の展開は、本人同意の得られる範囲で行うということになったらしいと噂で耳にした。学術研究の適用除外の「若干の無理」なところ(「ミラクル解釈」と呼ばれた)は、その後令和3年改正で解消されたが、今このプロジェクトがどうなっているのかは連絡が途絶えているので知らない。

*14 この時点で、GDPRが統計利用を目的外とみなさないとしていること(5条1項(b))を参照している。

*15 このころは、次世代医療基盤法を使えるものにするために、匿名加工情報の匿名加工基準の方を捻じ曲げる(仮名加工相当にする)という圧がかかっていた。次世代医療基盤法の概念定義は個情法と独立する形になっていたので、独自に基準を設けることは可能で、次世代医療基盤法の匿名概念は個情法の匿名概念とは異なるのだという道に進みかねない状況があった。このような圧は医療分野に限らずあるので、そのような道に進んでいれば、個情法の匿名概念も世界と乖離してしまう危険があった。それが、令和2年改正によって仮名加工情報の規定が設けられた(役に立つ制度かはともかく)ことで、2020年ごろにその問題は決着し、懸念された事態は回避された。

*16 この会合は、横山均内閣官房行政改革推進本部事務局長(現・長崎県立大教授)の計らいでお招きいただいたもので、結論として、「個人データのうち、仮名化した「仮名化データ」について、医療に関するものに限定して、取扱いルールを変更する特別法(個別法)の立法をしてはどうか」という提案をしている。そこでは、仮名化と匿名化の違いを説明する必要があり、次世代医療基盤法が匿名加工ではうまくいかないことを説明する必要があった。この時、事前に得た感触から、「本人の治療・指導に直接用いる話」(一次利用)と「統計量に集計して分析し科学的知見を得て利用する話」(二次利用)を区別することに特に注意を払ったが、やはり混同されてしまうようだった。

*17 この時点で、GDPRの5条1項(b)に加え、前文162を参照して、「統計利用は、個人について評価や決定を行う用途に用いられないから」と説明していた。「個人データを保護する本来の目的が忘れられている」「欧州発の本来のデータ保護の意義は「データ処理による個人の選別」を人権侵害と捉えたもの(統計への利用はこれに当たらない)」とも書いていた。この時点ではまだ、OECD第2原則の関連(relevant)性要件の存在に気づいておらず、どのような「選別」が人権侵害なのかをわかっていない。

*18 この時、「統制された非選別利用」のキャッチコピーを考案して初めて使った。医療分野に限らない一般化された構想となっている。複数組織からの個人データを突合する必要性についても触れている。これは、JILISの秘密計算TFの成果に基づいている。関連(relevant)性要件の存在にはまだ気づいていないので、どのような選別が問題なのかは説明できていない。少なくとも選別しないのであれば問題がないと主張するにとどまっている。この時の学界の反応は冷たいもので、「選別」の何が問題なのかわからないという陰口が伝わってきたが、どういうことなのかと聞かれもしなかった。

*19 この時は、図4「正当化スキームの違い」(9頁)として、「同意万能」「公益無罪」「自己情報コントロール」「21世紀の原油」「情報銀行」「APPA」との対比をしていた。この時点ではまだ稚拙な表現しかできていなかったが、統計利用が正当化されるのは公益性があるからではなくそもそも権利利益を害さないからである(比例原則で個別に判断を要するようなものではない)ということを言おうとしていた。

*20 この時点までに、Jon Bingの「決定指向利益モデル」の論文を発見し、OECD第2原則の関連(relevant)性要件を理解するに至っており、この時、「統制された非選別利用」モデルの裏付けと、選別利用の何が問題なのかが明確になったと述べている。これにより、真正面から制度提案ができるようになった。ちょうど、このシンポジウムの企画から実施までの間に、EUからEHDS法案の欧州委員会提案が出てきて(2022年5月3日)、二次利用規定の第1に決定利用禁止があり、ほーら言ってた通りじゃん!となった。しかし、この時点でもなお、なぜそうなのかの根拠に、GDPRの5条1項(b)と前文162を参照するほかなく、「やはり同じ考え方に基づいて設計されているのでは」としか言えていない。GDPR 89条1項を受けたsafeguardsとして英国やフランスの国内法に決定利用禁止があるのに気づいたのはこの直後だった。

*21 この時、図1で「IDを残した仮名化」について言及している(11頁)。このことは、仮名加工情報とは異なり、そこでいう「仮名化」は必ずしも全ての識別子を削除しなければならないわけではないことを意味している。

*22 GLOCOM六本木会議からの提言(ドラフト版)として端的な理論の説明を完成させた。この時、「情報的他律からの自由」のキャチフレーズを初めて使用している。英国やフランスの国内法に決定利用禁止があることも盛り込んだ。

*23 これらの提言の内容を、規制改革推進会議のWGで話すよう、3回に渡り呼ばれた。限られた時間で委員の方々に理解いただくのは容易でなく、決定利用禁止が条件であることの意味が伝わらない。案の定、決定利用が禁止されてしまえば統計により知見を得ても使うことができないのでは?との疑問を挟まれたようだったので、統計で得た知見を「本人の治療・指導に直接用いる」決定に用いるのはまた別のフェーズだという説明をしなくてはならず、そもそも決定の何が問題なのかを説明するために関連性の原則の説明をしているが(議事録1、議事録2)、伝わらなかった。

*24 GLOCOM六本木会議からの提言(確定版)を発表。年明け、この提言書を携えて、個情委事務局や厚労省医政局などに説明行脚に出かけた。個情委事務局の反応は「???」という感じであり、厚労省の反応は、法令で定めれば個情法上は合法になるが個情法の趣旨に反した法令を定めることはできないんだぞ的なもので、だからこれが個情法の趣旨だという提言なのだと説明をしたのに通じないようで、徒労感いっぱいで帰ってきたのであった。

*25 規制改革の答申を受けて、GLOCOM六本木会議から「緊急アピール」と題してウェビナーを開催した。緊急アピールしているのは、規制改革で我々の提案が曲解されてしまい、決定利用のうち不利益決定は問題だが利益決定は禁止する理由がないとされてしまったことである。実際に挙がっていた例は、統計目的で本人同意なく集められた二次利用データを分析する過程で治療や指導が必要そうなデータ対象者が見つかった場合に、当該データ対象者に知らせることの是非である。

*26 これが集大成となったが、この時点ではまだ、欧州評議会の1997年勧告を見つけていない。見つけたのはこの10日後であった。

*27 各国の署名に附されたのは1981年だが、閣僚委員会で採択されたのは(OECDガイドラインの直前)1980年。

*28 CETS 108 9条3項:

Article 9 – Exceptions and restrictions

3 Restrictions on the exercise of the rights specified in Article 8, paragraphs b, c and d, may be provided by law with respect to automated personal data files used for statistics or for scientific research purposes when there is obviously no risk of an infringement of the privacy of the data subjects.

*29 GDPRでは89条2項がこれに相当する。

*30 実際、英国の国内法では、GDPR 89条1項を受けた規定(19条3項)で、措置または決定(measures or decisions)の目的の場合には、approved medical researchである必要があり、倫理審査を要する旨が規定されており、裏を返せば、データ保護法からの要請で倫理審査を要するのは、措置または決定(measures or decision)の目的がある場合である。日本の医学系倫理指針もこれに倣って、データ対象者に対する措置または決定の有無で区分して、倫理審査のあり方を整理するのがよいだろう。個情法令和3年改正で学術研究例外が精緻化され、「個人の権利利益を不当に侵害するおそれがある場合を除く」との条件がついているが、「個人の権利利益を不当に侵害」とは何かが不明なままである。欧州評議会勧告が示しているように、データ対象者に対する措置または決定(measures or decision)に用いない場合にはその侵害がないものと整理すべきであり、倫理指針がその位置付けを規定する立場にあるのだが、これまでのところそのような様子が見られない。

*31 この辺りについては、高木浩光「国民総背番号とは何だったのか : マイナンバー「利用範囲拡大」が炙り出すもの」世界975号(2023)172頁以下、182頁を見てほしい。

*32 NDBがこのような変換符号を用いた突合のプロジェクトを進めてきたのは、海外でそのような事例があるのを見ているからだろうと思われるが、欧州でそうした事例があるのは、この勧告が示すように、統計目的であればこのような保護措置の上で処理が許されるということが、1997年までに整理されていたからこそであろう。日本では、そうした法律論上の整理ができないまま、技術的に真似ようとしてきたわけである。

*33 説明覚書は、「統計結果」の節で、統計開示制御(statistical disclosure control)に言及している(第58段落b)。「一部の国家統計機関と科学界との間で、「統計開示制御」の自動的な方法の開発に関する協力が行われていることに注目した。この作業は、原則14.1が主張する間接的な識別の防止措置を体系的に適用することを目指しており、したがって、原則15.4および17.1が奨励する種類の技術的発展である。」と書かれており、今で言うPETsの奨励である。日本では、平成27年改正時の議論を経て、情報セキュリティ分野の研究者の一部が統計開示制御の議論に参入するようになったが、米欧では、公的統計の分野で1960年代から研究されていたようで、1997年時点で「自動的な方法の開発」が話題になっていた様子が窺える。

*34 法とコンピュータ学会第38回研究会パネルディスカッション(2013)など。

*35 改めてこの日記を読み、前掲注10のISO/IEC 20889:2018の表に照らしてみると、ノルウェー法は、2001年時点で既に、「de-identification」が「anonymization」になる場合とならない場合があることを認識して区別していたところ(ISO 25237:2008もそれに揃っているっぽい)、2014年の改正で、29条作業部会の2014年意見と揃ったもの(用語は異なって「indirectly identifiable」)にしていたようだ。

*36 いや、10年前にこれを私が見たとしても、その意味をはたして理解できただろうか。今、完全に理解できるのは、「決定指向利益モデル」を理解しているからであるし、自分で考えてきたからこそ、すぐに理解できる。背景にある膨大な経緯を踏まえていなければ、この勧告の説明覚書を見ても、その意義や価値が頭に入ってこないかもしれない。1990年代後半にこれだけのものが整理されたのは、1970年代から一貫してこの分野に携わってきた専門家らが活躍してこそだったのではなかろうか。その点、2010年代以降、かつてのレジェンドたちが続々とこの世を去っており、EUも精緻さを欠く場面が見られるようになっている気がしている。

*37 ちなみに、この辺りの話は、生成AIと著作権の話にも通ずる。そこはまたいずれ。

*38 このことについては、前々回の日記「連載論文全体の圧縮版を生成した」と、その前の回「連載論文の解説をChatGPT 4o Image Generationで図解してみた」あたりを見ていただきたい。

*39 実際、「関係ないデータ項目によって決定されることがプライバシーの侵害である」という主張も、いくらか説得力を持つだろう。

*40 この辺りは、いわゆる「group privacy」の話と関係してきそうだ。